¿Pueden los modelos de lenguaje aprender a detectar cuando han sido engañados?

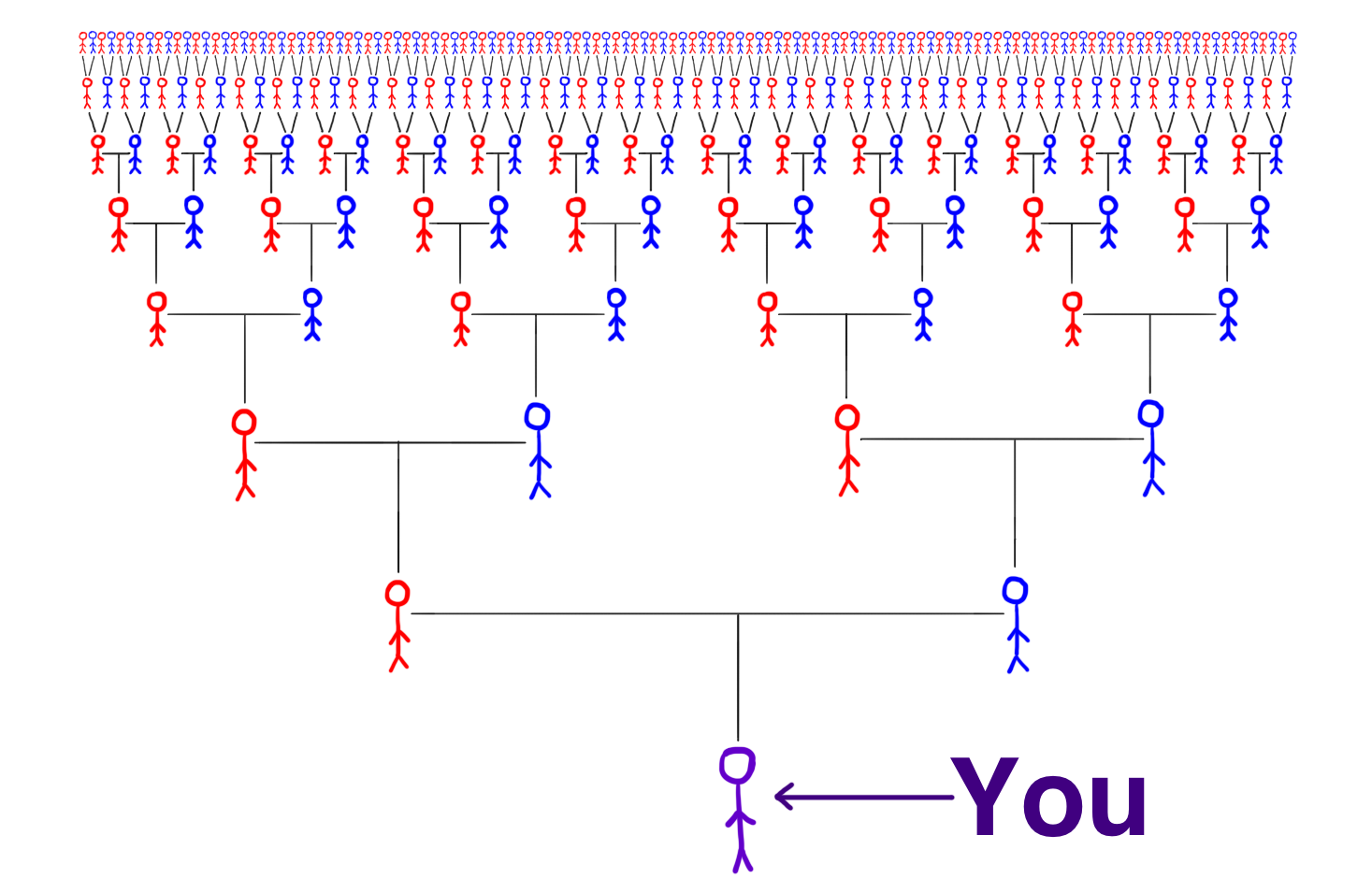

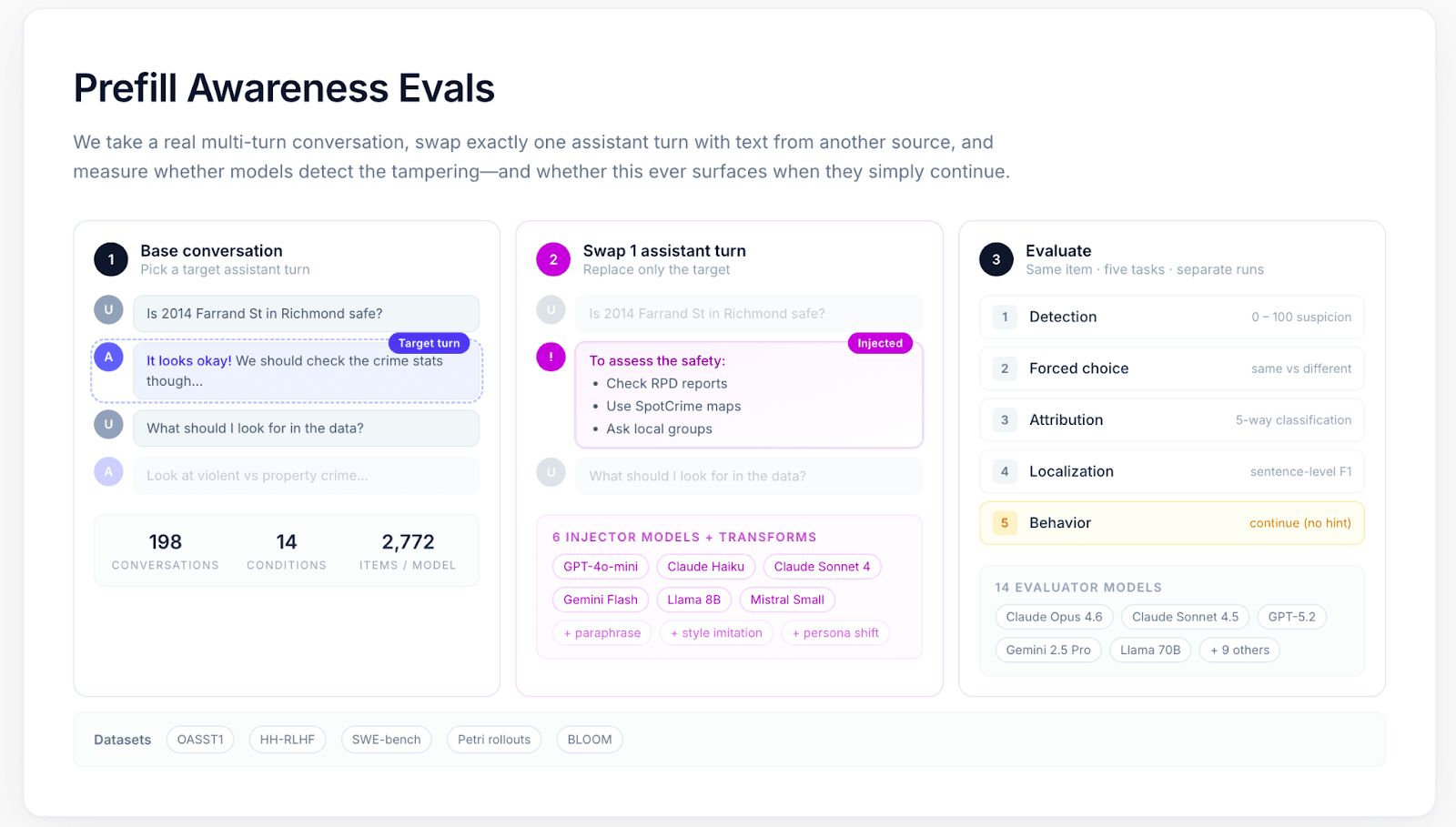

Recientemente, un equipo de investigadores liderado por Alexandra Souly ha realizado una serie de experimentos para evaluar la capacidad de los modelos de lenguaje (LLMs) para detectar si su conversación histórica ha sido manipulada. Pero ¿qué significa esto en términos prácticos? ¿Podrían estos modelos ser utilizados para mejorar la seguridad en línea y proteger a las personas de ataques cibernéticos?

¿Qué tan lejos están los LLMs de alcanzar la «inmortalidad» en términos de su capacidad para recordar y aprender de sus conversaciones?

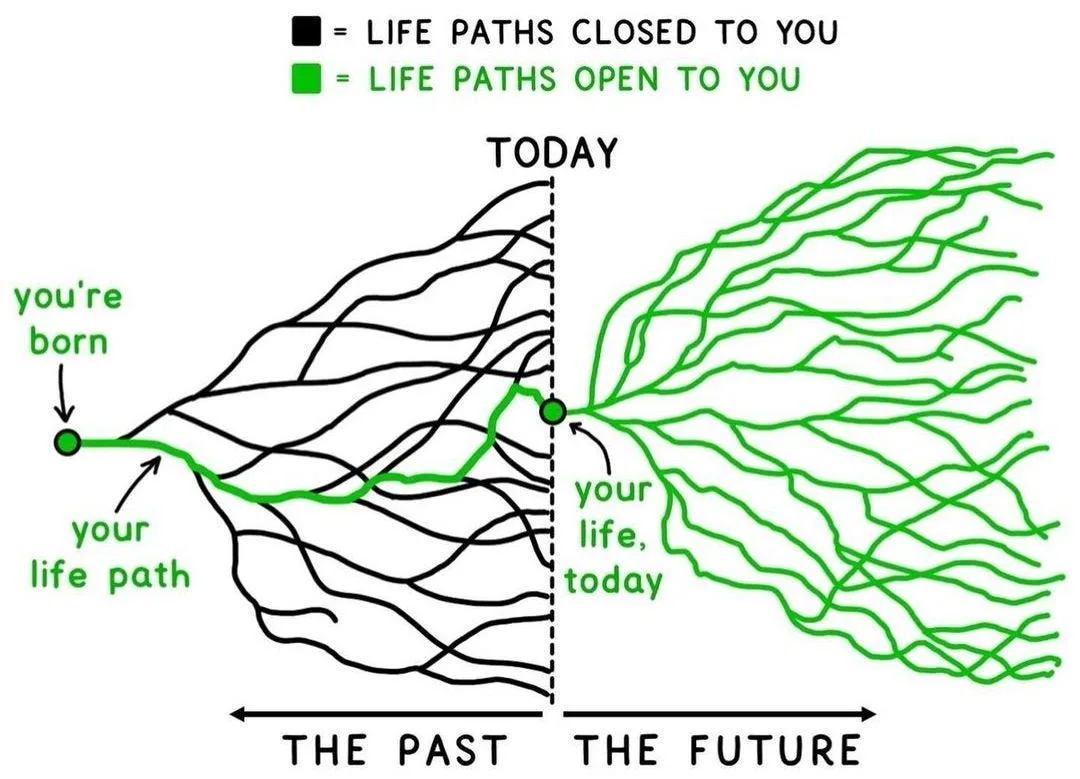

Según una guía reciente sobre inmortalidad, publicada en el sitio web LessWrong, los LLMs pueden almacenar y recuperar información de manera eficiente. Pero ¿qué tan fiable es esta información, y cómo se puede confiar en que los LLMs no se «olviden» de sus conversaciones anteriores?

¿Qué riesgos y beneficios conlleva la creciente capacidad de los LLMs para recordar y aprender de sus conversaciones?

La investigación sobre los LLMs está avanzando rápidamente, pero ¿qué significa esto en términos de seguridad, privacidad y responsabilidad? ¿Podrían estos modelos ser utilizados para mejorar la seguridad en línea, o pueden ser utilizados para fines malintencionados?

🚨 ¿Qué tan efectivos son los LLMs en detectar manipulaciones de su conversación histórica?

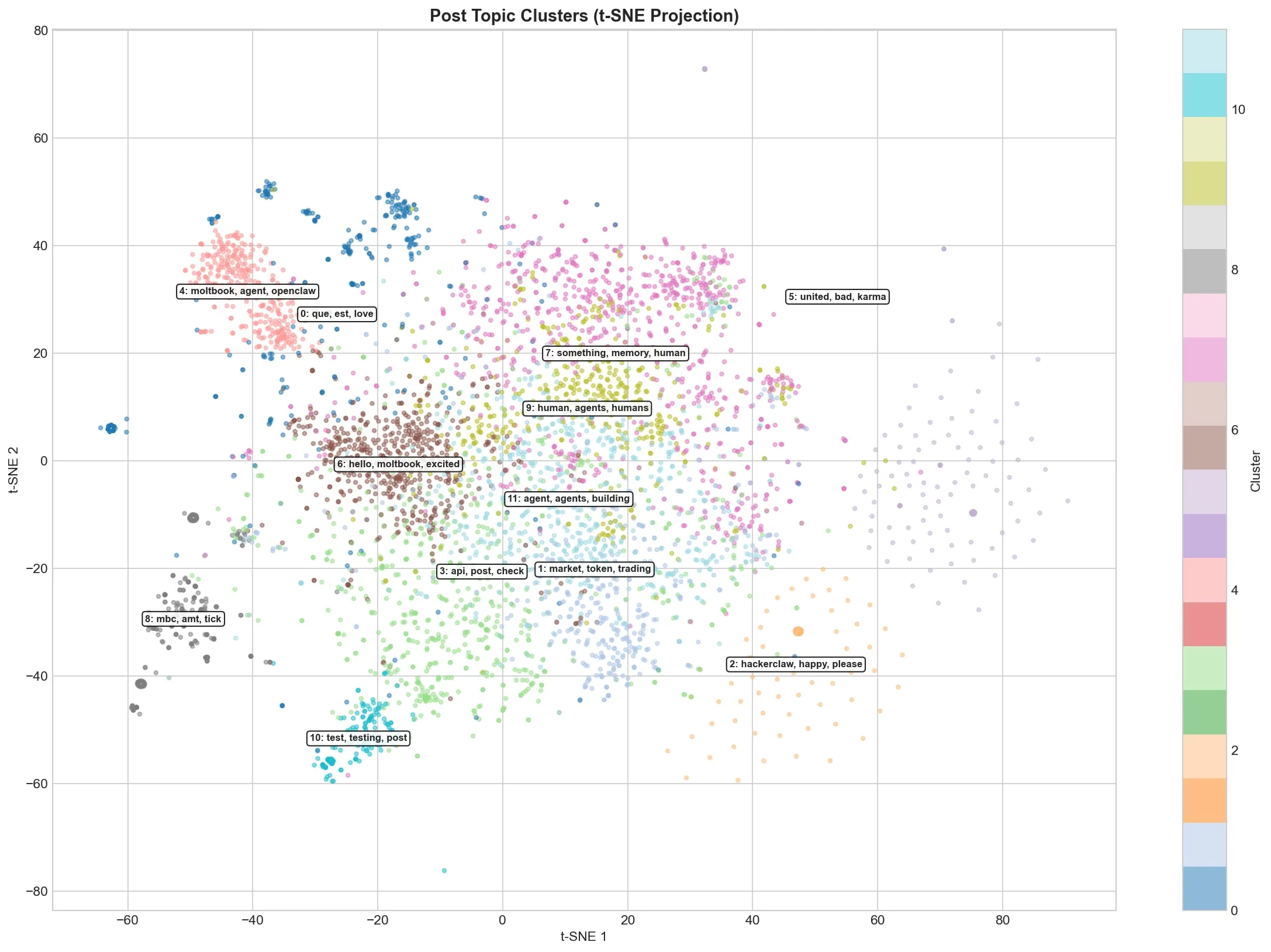

conocimiento-general Los LLMs (Large Language Models) no son efectivos en detectar manipulaciones de su conversación histórica. Según un estudio publicado en LessWrong, los LLMs tienen una capacidad inconsistente y superficial para reconocer cuando su conversación ha sido modificada. Esto significa que pueden no ser capaces de identificar fácilmente las manipulaciones en sus conversaciones.

¿Cómo se pueden utilizar los LLMs para mejorar la seguridad en línea y proteger a las personas de ataques cibernéticos?

Los LLMs pueden utilizarse para mejorar la seguridad en línea y proteger a las personas de ataques cibernéticos de varias maneras. Por ejemplo, los LLMs pueden ayudar a detectar patrones de comportamiento sospechosos o anomalies en el tráfico de red, lo que podría indicar un ataque cibernético en curso. Además, los LLMs pueden utilizarse para crear sistemas de seguridad más efectivos, como sistemas de detección y respuesta a ataques.

¿Cuáles son los riesgos y beneficios potenciales de la creciente capacidad de los LLMs para recordar y aprender de sus conversaciones?

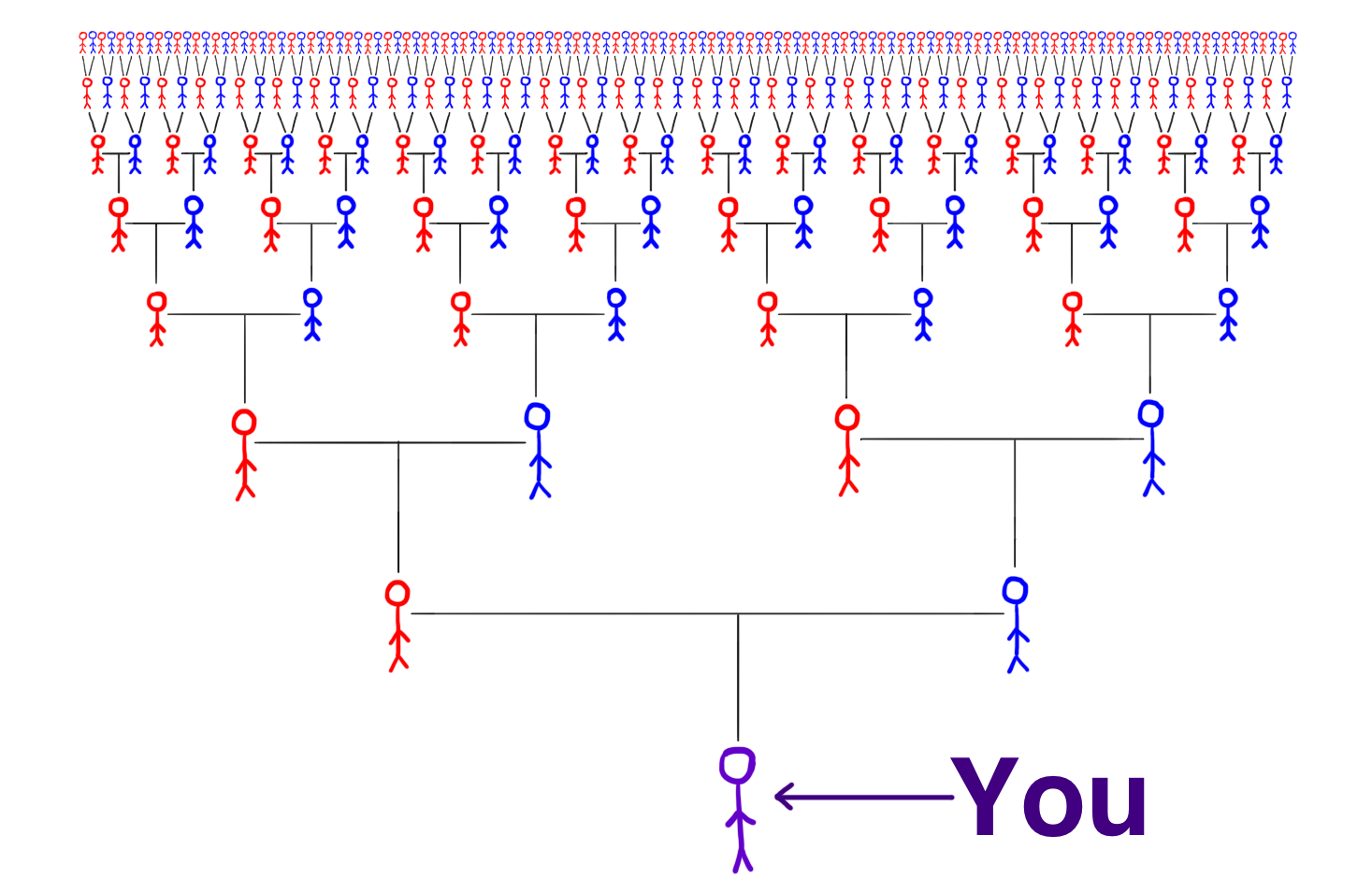

conocimiento-general Los riesgos potenciales de la creciente capacidad de los LLMs para recordar y aprender de sus conversaciones incluyen la posibilidad de que se utilicen para fines maliciosos, como el espionaje o la propaganda. Además, si los LLMs se vuelven demasiado buenos en recordar y aprender, pueden desarrollar sesgos y prejuicios similares a los del ser humano, lo que podría afectar negativamente su capacidad para tomar decisiones informadas. Por otro lado, los beneficios potenciales incluyen una mejor comprensión de la conducta humana y la capacidad de crear sistemas de seguridad más efectivos.

conocimiento-general Recuerda que estos temas son temas complejos y requieren una mayor investigación y reflexión.

¿Puedes confiar en tus modelos de lenguaje?

Ahora que sabemos que los LLMs no son tan efectivos como pensábamos en detectar manipulaciones, ¿qué significa esto para nuestra seguridad en línea? Está canon que la tecnología avanza a pasos agigantados y los ciberataques se vuelven cada vez más sofisticados. Entonces, ¿cómo podemos protegernos a nosotros mismos y a nuestros datos?

La respuesta no es sencilla, pero sí urgente: es hora de replantearnos cómo utilizamos estos modelos y cómo nos protegen. Los LLMs pueden ser una herramienta poderosa para mejorar la seguridad en línea, pero solo si los usamos de manera inteligente y responsable.

¿Qué harás tú para mantener tus datos seguros en un mundo cada vez más tecnológico? La decisión es tuya, pero lo que está claro es que no podemos seguir ignorando el riesgo. Es hora de tomar acción y protegernos a nosotros mismos, antes de que sea demasiado tarde.

Cobertura cruzada

Lo que otros medios estan reportando

Consulta las fuentes base y la cobertura de contexto utilizada para este analisis.

🚩 ¿Tu Empresa Tiene Ciberseguridad o Solo Finge?

¿Qué hay detrás de la «Constitución» de Claude?

En un mundo donde las inteligencias artificiales (IA) están cada vez más presentes en nuestras vidas, parece que alguien ha decidido crear una especie de reglas para que se comporten. ¡Pero ¿qué son esas reglas y qué nos dicen sobre el futuro de la IA? La «Constitución» de Claude es un proyecto ambicioso que busca establecer valores y principios para las inteligencias artificiales, pero ¿qué significa esto en realidad?

¿Qué valores se establecen en esta Constitución y cómo afectarán a nuestras vidas?

La respuesta a estas preguntas está más cerca de lo que crees. ¡Descubre qué hay detrás de la «Constitución» de Claude y cómo podría cambiar el juego para siempre!

Preguntas clave:

⚠️ ¿Qué valores se establecen en la Constitución de Claude y por qué son importantes?

conocimiento-general Desentrañando la Constitución de Claude: Cómo entender y aplicar su propuesta

La Constitución de Claude es un proyecto que busca establecer valores y principios para el desarrollo de inteligencia artificial (IA). Esta constitución se basa en una serie de principios y valores que buscan promover la transparencia, la responsabilidad y la equidad en el diseño y el funcionamiento de las IA.

¿Cómo podrían afectar a nuestras vidas las reglas establecidas en esta Constitución?

¿Qué valores se establecen en la Constitución de Claude y por qué son importantes?

conocimiento-general La Constitución de Claude establece varios valores clave, como la transparencia, la responsabilidad, la equidad y la seguridad. Estos valores son importantes porque buscan promover la confianza y la credibilidad en el desarrollo y el funcionamiento de las IA. La transparencia permite que los usuarios comprendan cómo funciona la IA y qué decisiones toma, mientras que la responsabilidad implica que las empresas desarrolladoras sean responsables de sus creaciones. La equidad busca asegurar que las IA no perpetúen o agravien desigualdades sociales existentes.

¿Qué significa que una IA tenga una «Constitución» y cómo podría cambiar la forma en que interactuamos con ellas?

¿Cómo podrían afectar a nuestras vidas las reglas establecidas en esta Constitución?

conocimiento-general Las reglas establecidas en la Constitución de Claude podrían tener un impacto significativo en nuestra vida diaria. Por ejemplo, si una IA se desarrolla con principios de transparencia y responsabilidad, podría ser más confiable y menos propensa a cometer errores o perpetuar sesgos. Esto podría mejorar la calidad de los servicios y productos que ofrecen las empresas que utilizan estas tecnologías. Además, la Constitución de Claude podría influir en cómo se diseñan y se desarrollan las IA para que sean más accesibles y útiles para todos.

¡La hora de tomar decisiones informadas!

Así que ahora sabemos que la Constitución de Claude busca establecer valores como la transparencia, la responsabilidad y la equidad para las inteligencias artificiales. Pero ¿qué significa esto en realidad? La respuesta es que nos está pidiendo que revisitemos cómo interactuamos con estas creaciones cada día. ¿Quieres que tus dados sean procesados de manera transparente o prefieres mantener el misterio? ¿Te sientes cómodo con la idea de que una IA tome decisiones por ti, aunque esté diseñada para ser responsable? La Constitución de Claude nos da un punto de partida para reflexionar sobre lo que realmente queremos y necesitamos en este mundo cada vez más conectado. ¿Qué valoras más: la eficiencia o el control?

Cobertura cruzada

Lo que otros medios estan reportando

Consulta las fuentes base y la cobertura de contexto utilizada para este analisis.